最近两天在玩阿里新开源的Wan2.1。

网上很多关于这个模型的文生视频演示,但图生的不多,所以我想说说图生。

敲了一堆字又删了,还是直接上演示。

此刻,我的电脑桌上方的置物架上摆着一个超级索尼子的兔女郎手办,长这样:

随手一拍,用作素材。

这套兔女郎装,我看她高跟鞋有点高,脚腕子应该是站酸了。

不如就让她活动活动:

腿也麻了?那做个操?

注意看影子的跟随,这就是部署在本地的Wan2.1跑出来的效果。

如何?

翻素材的时候刚好翻出来一年前在本地跑的视频,也放上来给大伙看下,长这样:

不由感慨,技术进步真是太快了。

再来跟扛把子可灵做个对比吧。

这是我用SD1.5生成的图片:

那时候超级喜欢双手插兜,经历过的应该都懂。

她绝对想不到有一天我们会让她把手从口袋里拿出来撩头发。

提示词:

一位身着白色水手服的青春女学生,黑色直发齐刘海,面容清秀,红润的嘴唇。站在校园楼梯间,阳光透过窗户斜射进来,在她脸上和白色衣服上形成温暖的光斑,背景是模糊的楼梯和栏杆。她轻轻眨动眼睛,嘴角缓缓上扬形成浅浅的微笑,随后低头看向地面,手指不经意地轻抚过垂落的发丝,将它们别到耳后,又将双手轻轻放入校服口袋,微微侧头望向远方,眼神中流露出些许思考和憧憬的神情。镜头采用近景拍摄,柔和地捕捉她细微的表情变化和动作,随后缓缓平移至侧面,展现她站立的优雅轮廓。整个场景充满宁静与温暖的氛围,洋溢着青春的气息,日系青春电影风格,柔和复古的色调,如同胶片相机般带有淡淡的怀旧感。

先来Wan2.1。

参数使用fp8/14b/480p/20steps/24fps,这样生成3-5s的视频,RTX4090显卡基本可以控制在5-10分钟以内,与线上平台相当。

生成两段吧,一段3s,一段5s。

3s版:

5s版:

接下来可灵。

直接使用最新的可灵1.6,上传图片进行首帧生成。可灵视频长度可选5s和10s,有标准和高品质两个版本。

我们统一选择5s长度,两个版本各生成一条。

标准版:

高品质:

单以成片效果来看,个人觉得最强的还是可灵1.6的高品质模式,不得不说,可灵确实强。但Wan2.1的水准我认为可以算在可灵标准版和高品质版之间,尤其是指令跟随,明显强过可灵标准版。

并且,当你使用家用消费级以上的显卡时,也可以继续提高Wan2.1的精度、步数和分辨率,获得更好的效果。

对AI视频领域有过了解的朋友都知道,图生视频在工程上的重要性远比外界想象的大。如果只使用文生视频,成片难度简直几何倍数提高。

PS:昨天AI.TALK汗青老师新发布的短片《LONELY》,完全使用Google VEO2文生视频创作,没有用到图生视频,牛逼。

同时,图生视频在视频创作之外的通用工作场景的应用,我认为也比单纯的文生视频更高。

比如我之前介绍Mermaid这篇文章:DeepSeek-R1使用技巧:学会这一句Prompt,让AI帮你生成多种酷炫图表的封面,如果有人还记得的话,长这样:

假设说,我现在正在制作一个演示用PPT,这是我的PPT封面。我想让它更酷炫一点,我想让水和鱼儿都动起来,但背后的Mermaid文字不要变化,怎么办?

这种需要,Wan2.1图生视频就可以完成。

提示词:

一幅动画风格的美人鱼场景,橙红色”Mermaid”文字悬浮在画面上方。深蓝色水域中,红发美人鱼少女浮在水面,身着橙红色贝壳上衣,长发在水中轻轻飘动,眼睛眨动,嘴角微微上扬。周围的橙红色鱼儿灵活游动,有的从她身边穿过,有的在深处游弋。水面泛起涟漪,光影在水下闪烁变幻。镜头采用固定视角,捕捉水中生物的自然流动感。整个场景充满梦幻而神秘的氛围,动漫插画风格,色彩对比强烈,蓝色水域与橙红色元素相映成趣。

生成的视频:

上面两张底图都是来自AI生成,使用照片的话可以得到更真实的效果。

例如这张图:

提示词:

镜头从侧面捕捉一位身着黑色西装的精英商业人士,站在装饰华丽的走廊中,手持一杯咖啡。他面容沉稳,眉头微皱,眼神中透露出思考和决断。他将咖啡杯缓缓举至唇边,轻啜一口,随后微微低头注视杯中液体,眼神中闪过一丝满足和释然。背景是米色墙壁和金色相框,营造出正式而庄重的氛围。镜头采用近景拍摄,捕捉他饮用咖啡时微妙的表情变化。整个场景充满力量与沉着的氛围,商业纪实风格,色调冷静而克制。

输出视频:

以及,Wan2.1作为能在本地部署的开源模型,就会有一些线上平台无法比拟的优势,SD玩家懂得都懂。

友情提醒:小擦怡情,大擦伤身。

再来说说本地部署。

说先还是要给个大大的赞的,相比隔壁阶跃的Step-Video-T2V,上来就要80G显存,万相起码有的玩。

但说实话,Wan2.1满血本地运行还是很吃力的,毕竟是生成视频,算力要求比Flux.1肯定是高。图生视频是14B模型,我自己用4090亲测,还是fp8量化的480p用起来更舒服一些,再高的精度或者分辨率,就会让生成时间变长,导致体验下降。

结合我自己的经验,不太建议4070Ti以下的玩家进行本地部署。除非你是文生视频需求。

万相贴心地准备了一个1.3B/BF16精度的文生视频模型,4070就可以流畅运行。4090生成一个3s视频的时间更是不到一分半。

本文插入视频数量已经到达上限了,效果就不放了。个人评价是,除非你要的量大,或者说在这个生产流程中介意水印,那使用线上文生图也是不错的选择。

但我认为本地部署依旧可以聊聊。为什么呢?因为很多人喜欢讲卡,却忽略了算力租赁这件事儿。

关于AI时代个人可以获取的buff,我一直有点粗浅的见解:有两项云服务,可能会越来越从ToB转向ToC。一个是云服务器,一个是云端算力。

个人云服务器,我之前的文章经常有提到。不到100元/年的租赁价格,可以获得一个随时随地都能访问的公网IP,加上一台更适合生产的Linux主机,配置不高但对个人来说够用。有了它你就可以调用各种AI的API,通过AI编程的方式把它捏成最适合自己的形状,然后它就是成了你行走江湖的私有外挂,甚至你也可以开放给别人使用,提供服务。

个人云端算力,其实也可以算作云服务器的一种,只是配置更高。很多人跟我说你有4090如何如何,确实,舍得花钱买显卡也是个执行力壁垒。但我可以提醒一下各位的是,很多算力租赁平台租用4090也就是网吧的价格,从1块多到几块钱一小时,足以完成一些不需要长期跟进的事情了。这就像相机,有点反常识,都说胶片贵,冲洗翻拍还要加邮费,但买台数码按不够一定快门次数,还真不好说谁成本更高。

这里没接到广告啊,也不推荐平台,大伙儿自行判断。我就提醒一句,如果算力过于便宜,尽量不要放重要文件和数据进去。

下面是个人总结的一个路径较短且无需魔法的部署教程:

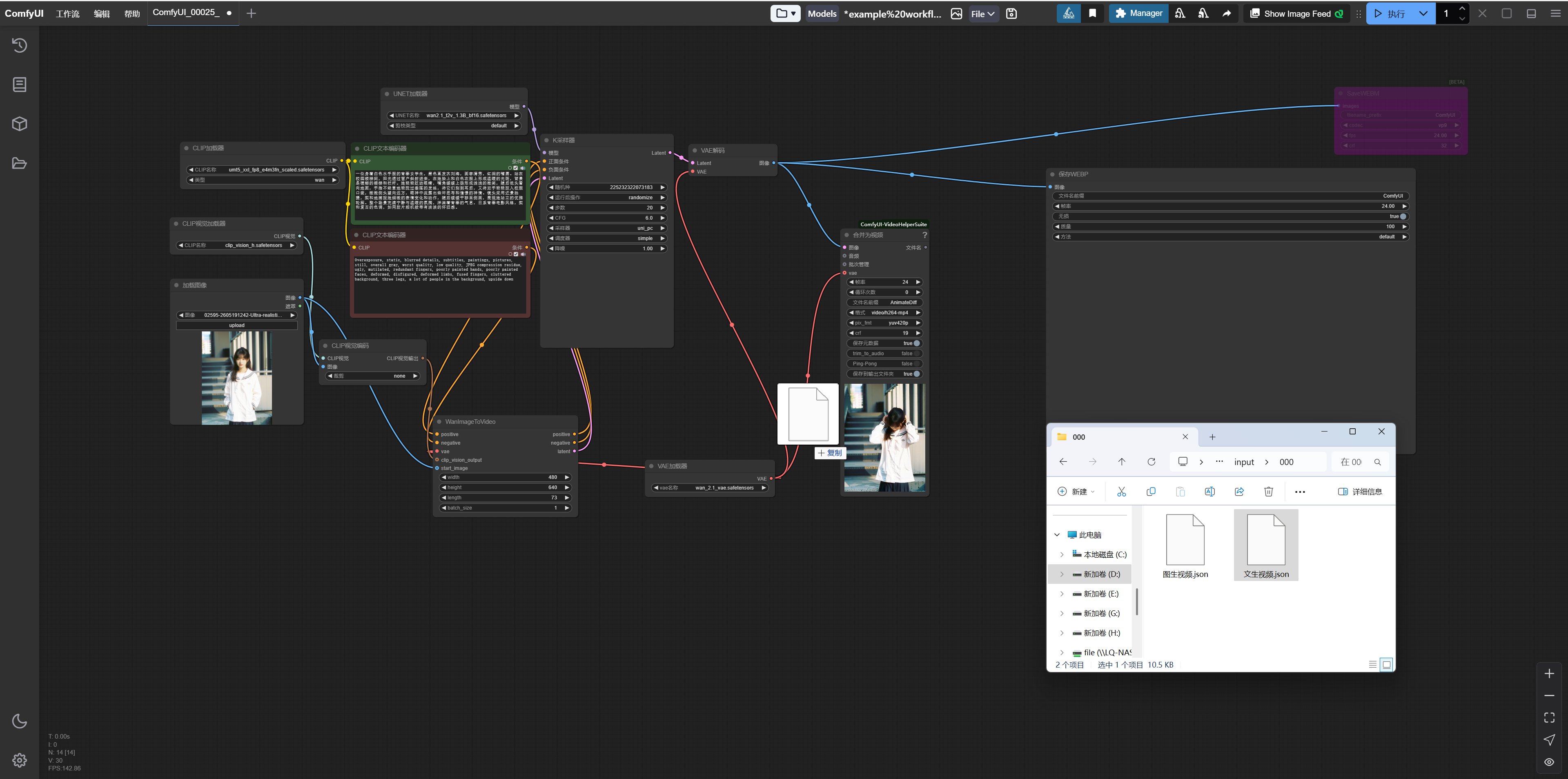

1.到B站下载一个秋叶ComfyUI整合包。

具体地址在下面这个视频的评论区:

https://www.bilibili.com/video/BV1Ew411776J

解压即用,记得更新版本到最新。

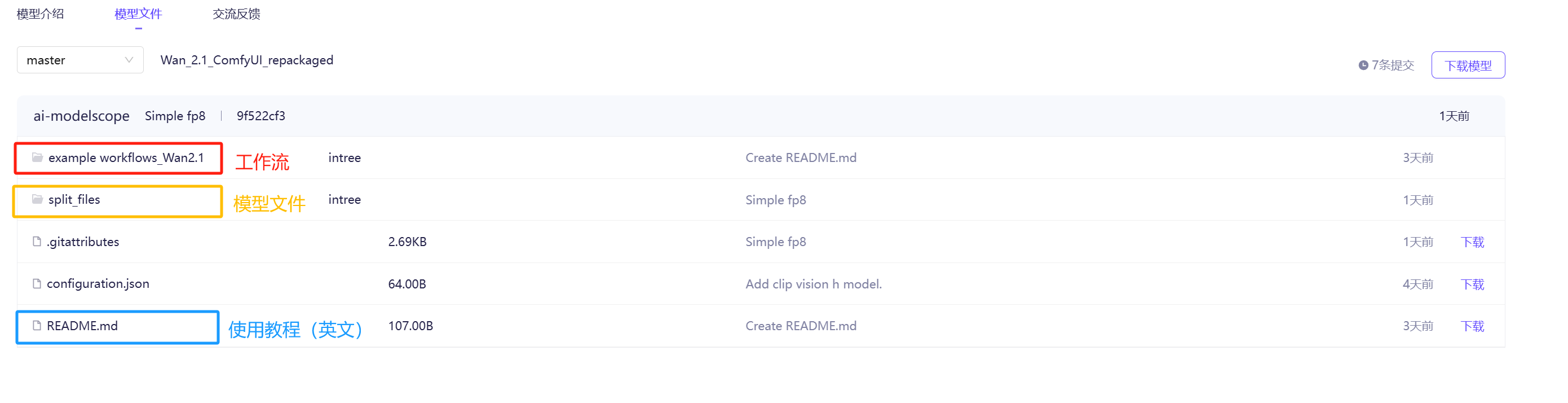

2.到魔搭社区下载Wan2.1模型。

魔搭社区是阿里云旗下的AI大模型开源社区,国内可以直接访问,而且文件下载速度很快。

我们不去直接下载通义万相发布的模型,那个部署起来需要一定的专业技术知识。我们去下载Comfy Org打包的模型,只要你上一步把ComfyUI更新到最新,那就不需要再安装任何的节点,开箱即用。

具体地址是:

https://www.modelscope.cn/models/Comfy-Org/Wan_2.1_ComfyUI_repackaged/files

目录结构大概是这个样子:

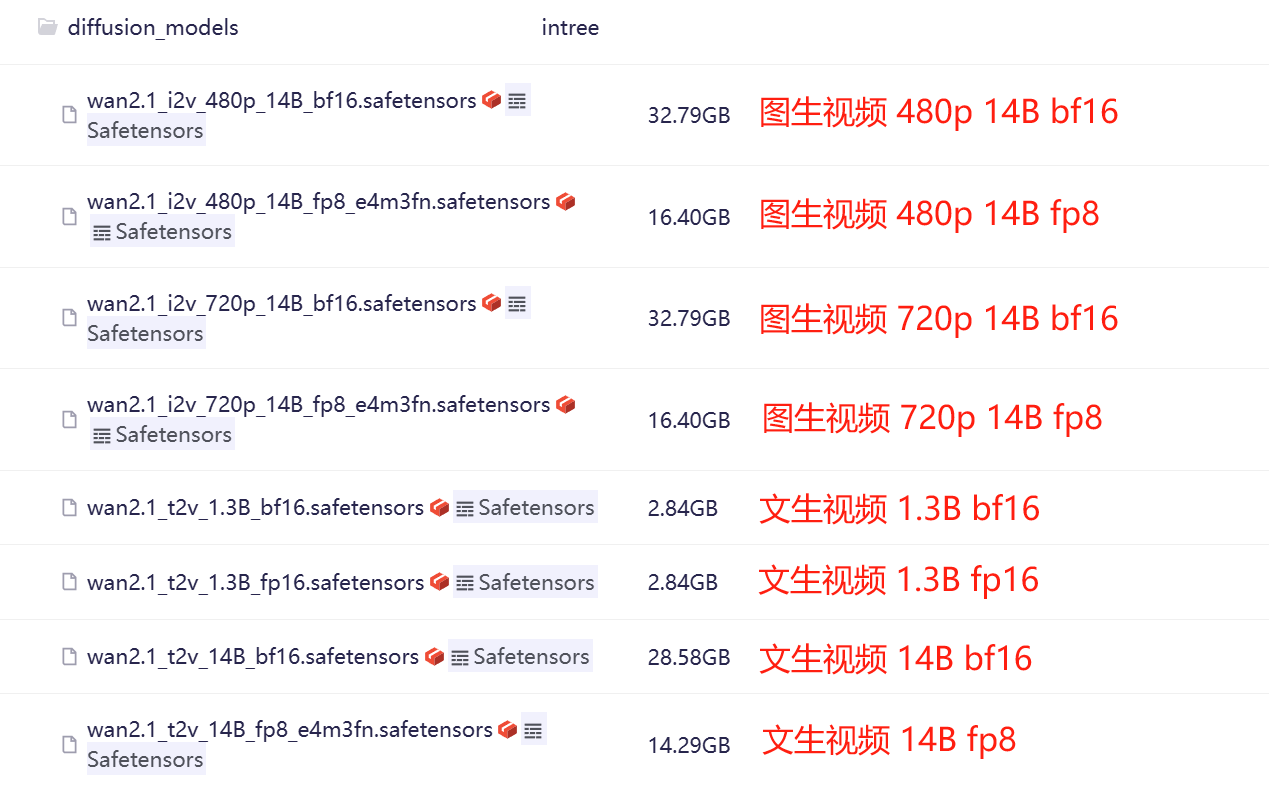

然后下载模型文件(即split_files文件加下的内容)。

一共4个子文件夹:

clip_vision下只有一个clip_vision_h.safetensors 文件,下载到ComfyUI目录Comfyui/models/clip_vision/。

vae下也只有一个wan_2.1_vae.safetensors文件,下载到ComfyUI目录ComfyUI/models/vae/。

text_encoders下有两个文件,分别是fp8和fp16精度的文本编码器,可以结合自己的电脑配置选其一,或者两个都下载。

diffusion_models下的文件较大,可参考下图,根据自己的配置按需下载。

做一个简单的说明:

①分辨率高,规模大,精度高的,更吃配置。

②文生视频1.3B的bf16和fp16效果基本上不会有什么差距,理论上bf更适合训练,fp推理优化更好。

③文生视频模型的分辨率,根据网上的信息,应该480p和720p皆可生成。

④下载文件夹内的文件或直接打包下载文件夹皆可,ComfyUI可以选择二级文件夹下的路径。

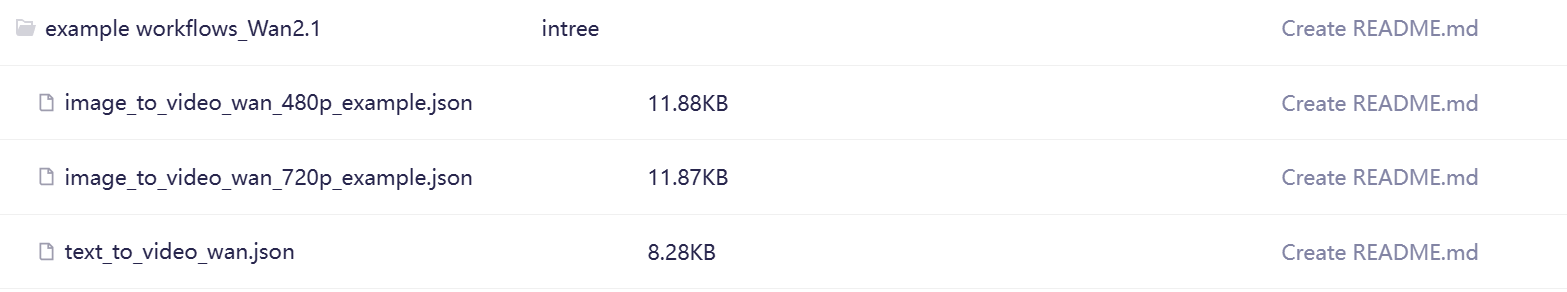

3.下载工作流。

ComfyUI提供了官方示例工作流,在example workflows_Wan2.1文件夹下。就下面这三个,可以直接下载:

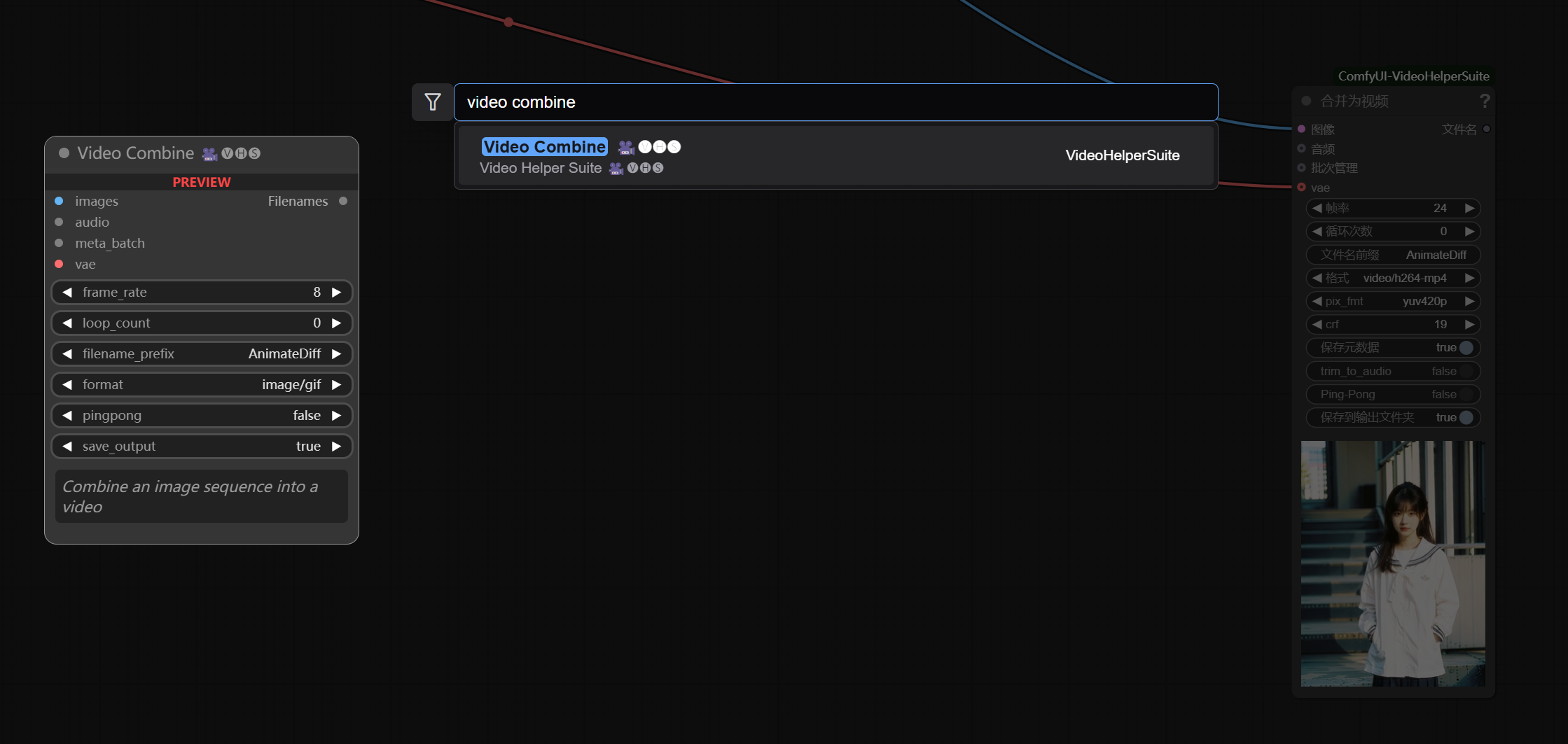

这个几个官方工作流没有加视频导出节点,如果你需要导出为视频,可以手动在最后串联一个video combine节点,格式选择h264-mp4或h265-mp4即可。

如果不会,也可以直接使用我添加好视频导出节点的工作流:Wan2.1工作流。

4.导入使用工作流。

导入工作流十分简单,启动comfyui后会自动打开一个这样的页面,把工作流json文件直接拖进去即可。

然后就可以生成你的视频了。

以上就是全部内容了,感谢关注!

发表回复